2023人工智能与几何研讨会举办

2023年10月15日,2023人工智能与几何研讨会在北京大学静园五院举办。本届研讨会由北京大学前沿计算研究中心主办,北京大学计算机学院理论计算机科学研究所、中国科学技术大学、中国计算机学会联合主办,邀请中科院计算所研究员孙晓明、微软亚洲研究院首席研究员陈卫、中科院计算所研究员张家琳等嘉宾,以及多位在理论算法、计算几何、人工智能等不同领域专家做学术报告并参与讨论。活动由北京大学前沿计算研究中心助理教授姜少峰、中国科学技术大学计算机学院教授丁虎组织及主持。

本届研讨会也是“CCF走进高校”系列活动之一。

报告视频回放:https://www.bilibili.com/video/BV1M94y1b76C/

活动伊始,中国科学技术大学计算机学院丁虎老师欢迎到场的与会嘉宾和同学们。他表示,希望此次活动能够为不同领域的学者、同学们提供一个交流、合作的平台。

开幕致辞

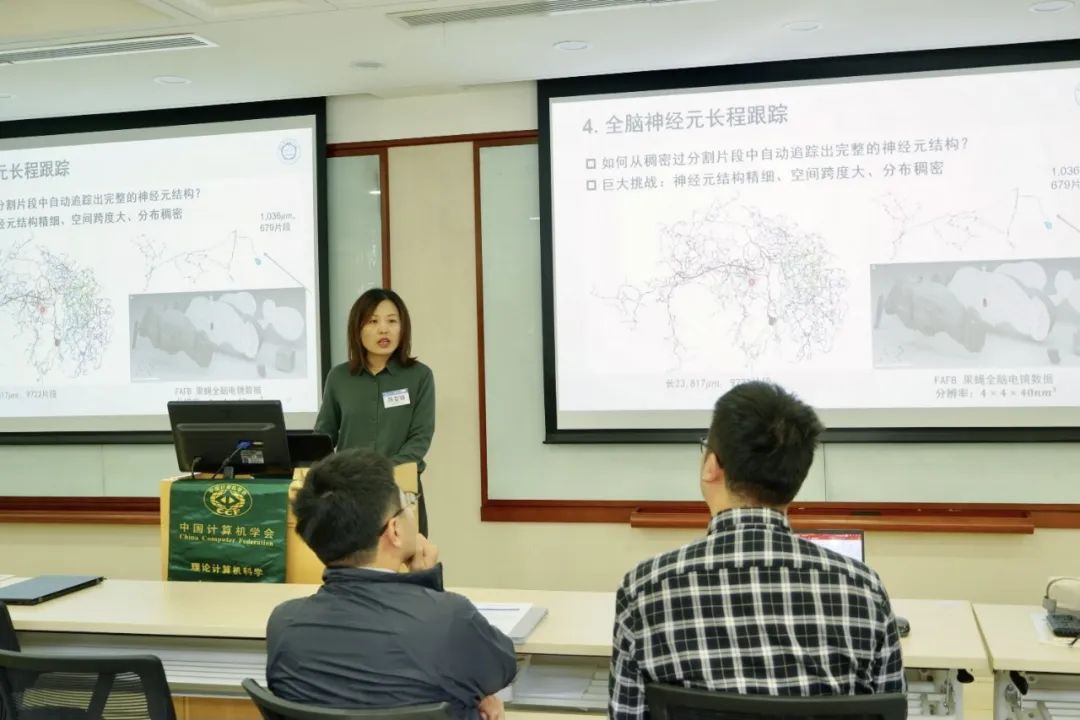

中国科学技术大学陈雪锦老师介绍了人工智能在处理脑图像中的几何结构方面的研究。近年来,计算机视觉领域对三维几何结构的建模和分析赋予了更多的关注,尤其在理解特定场景方面,这项任务既具有挑战性又至关重要。脑显微图像分析便是其中一项重要任务,陈雪锦教授在讲座中介绍了无监督学习、基于骨架的形态表征学习等方法,以及它们在神经元实例分割、神经元的长程追踪与重建、神经元形态分析等任务中的应用,并深入探讨了其中所面临的挑战与机遇。

脑显微图像的三维结构重建和分析

南京大学黄棱潇老师总结了欧氏几何空间中核心集构造算法的发展以及一些经典技术。核心集作为一种数据摘要技术,应对了大数据时代数据迅猛增长所带来的计算挑战。其主旨是寻找数据集的一个小代表集合,以便用其替代原数据集进行计算并获得近似结果。目前,核心集的研究主要集中在聚类问题上。黄棱潇老师首先以一维空间的 1-median 问题为例,介绍了一种基于“桶”划分的经典算法,并概述了他们在最新工作中得到的关于核心集大小的理论最优上下界。随后,黄棱潇老师介绍了如何通过将数据集映射到直线,构建出 d>1 维空间中的核心集,并讨论了适用于高维空间的环分解和重要性采样等核心集构造算法。

Coreset Construction for Clustering in Euclidean Spaces

清华大学李建老师分享了他们在扩散模型研究领域的最新进展。首先,他解释了扩散过程,这是一种逐渐引入噪声的随机过程,而 Anderson 定理提供了去噪的逆过程。扩散模型受到扩散过程的启发,通过神经网络学习得分函数,可以执行从噪音生成图像的任务。随后,他介绍了潜在扩散模型,该模型在潜在表示空间中生成图像,然后解码以生成更高质量的图像。最后,李建老师介绍了他们的最新工作,结合一种新的一致性模型与潜在扩散模型,实现了在任何预训练扩散模型上进行非常高效的推断,从而生成高质量图像,并且还介绍了一种专为自定义图像数据集精调的新方法。

Diffusion and Consistency Models in Latent Space

微软亚洲研究院张辉帅老师带来了他对于机器学习中经常用到的 SGD with Momentum (SGDM) 算法的新理解。关于 SGDM 什么时候 以及 为什么 比原始 SGD 算法更优,此前的研究众说纷纭,没有达成一个统一的结论。张辉帅老师课题组使用超参数和 batch size 对 SGDM 的学习率进行修正,实验结果表明,SGD 与 SGDM 在低学习率时表现基本相同,在高学习率时,SGDM 的优势将会逐渐显现。张辉帅老师课题组认为这样的现象与 Directional Hessian 在学习过程中的突然锐化有关,并通过理论推导佐证了他们的猜想。

When and Why Momentum Accelerates SGD?

北京大学前沿计算研究中心程宽老师介绍了他近期与前沿计算研究中心的姜少峰老师和另外两位同学一起合作的工作。该工作研究了核方法的快速近似计算问题,对于该问题中经典的 Random Fourier Feature (RFF) 方法,他们首次证明了该方法在核函数为解析函数时,核函数的目标维度可以不依赖于输入维度。当核函数不是解析函数时,他们在经典核函数 Laplacian kernel 上进行了分析,并指出此时 RFF 方法的目标维度必须依赖于输入间的最近距离。针对 Laplacian kernel,他们对 RFF 方法进行了改进,实验显示改进后的方法在随机数据点上的表现显著优于 SVD 和直接使用 JL-lemma 的效果。

On the Relative Error of Random Fourier Features for Preserving Kernel Distance

国防科技大学刘新旺老师介绍了其课题组最近提出的 SimpleMKKM 融合聚类框架及其相关拓展。区别于常用的 min-min/max-max 聚类算法,刘新旺老师课题组提出了一个全新的 min-max 模型,并设计了新的求解算法以保证得到的解具有全局最优性;同时,在不包含任何超参数的情况下,该模型在不同应用中展示了优越的聚类性能。进一步地,该报告介绍了基于核矩阵局部对齐思想对 SimpleMKKM 进行的拓展,并提出了 Localized SimpleMKKM 算法以及一种无参的样本自适应 Localized SimpleMKKM 算法。

新型多视图聚类分析

清华大学包承龙老师针对 μ-强凸问题,对 NAG-c (NAG: Nesterov accelerated gradient) 方法是否具有全局的 R-线性收敛性展开讨论。具体地,NAG-c 方法在一般凸问题的一阶方法中可以实现最佳迭代复杂度,但对于强凸问题,NAG-c 方法是否表现出全局 R-线性收敛仍然是一个悬而未决的问题。在此次报告中,包承龙老师介绍了可以通过某些构造的 Lyapunov 序列的 Q-线性收敛来积极回答这个问题。此外,当该结果扩展到加速近端梯度法的全局 R-线性收敛时,可以求解目标函数中具有非光滑项的强凸复合优化问题。

On the global R-linear convergence of NAG with unknown strongly convexity parameter

活动特别邀请中科院计算所研究员孙晓明、微软亚洲研究院首席研究员陈卫以及中科院计算所研究员张家琳与报告嘉宾、参会者们共同参与圆桌讨论,与会嘉宾围绕“大模型与计算机理论”这一主题各抒己见,提出了许多有启发性的观点。

Panel Discussion

活动最后,北京大学前沿计算研究中心的姜少峰老师代表主办方对与会嘉宾和同学们表示感谢,并对本次会议内容进行了总结。

会议总结

本次会议为与会专家学者提供了一个面对面交流的平台。参与者们积极提出问题,并得到了报告者及时且详细的解答,增进了学者间的交流与互动。同时,活动也为公众提供了一个了解人工智能与几何计算技术的机会,为领域融合创新提供了有力支持。

会议合影