王鹤课题组 ICCV 2023 入选论文(Oral)解读:UniDexGrasp++:基于几何感知课程和迭代通用-专家策略学习的灵巧手抓取算法

本文是 ICCV 2023 入选 Oral 论文 UniDexGrasp++: Improving Dexterous Grasping Policy Learning via Geometry-aware Curriculum and Iterative Generalist-Specialist Learning 的解读。本论文由北京大学王鹤研究团队与清华大学、北京通用人工智能研究院合作,是研究团队 CVPR 2023 工作 UniDexGrasp 的后续工作。

面对三千多种物体在任意位姿下的泛化视觉强化学习困难,我们提出了基于几何的课程学习,对视觉空间进行划分,并进行多轮交替的专家策略学习和向通用策略的蒸馏,第一次达成了成功率超过80%的、点云输入的通用灵巧手抓取策略。

文章在 ICCV 2023 中获得全满分的评审成绩并被评为口头报告展示(Oral Presentation)。

论文链接:https://arxiv.org/abs/2304.00464

项目主页:https://pku-epic.github.io/UniDexGrasp++/

代码地址:https://github.com/PKU-EPIC/UniDexGrasp2

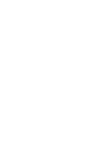

图1. 通用的灵巧手抓取

01 引 言

机器人抓取是机器人与环境交互的重要组成,也是机器人实现复杂操作的关键。尽管传统的二指抓取方法已经取得了很大的进展,但其在处理复杂物体也具有一定的局限性。相比之下,灵巧手抓取,特别是五指抓取,提供了更为丰富和多样的抓取方式。然而,灵巧手驱动空间的高维度既是赋予灵巧手这种多功能性的优势,也是难以执行成功抓取的主要原因。作为一种广泛使用的五指机器人灵巧手,ShadowHand[1]拥有26个自由度(DoF)。这种高维度加大了生成有效抓取姿势和规划执行轨迹的难度,从而迫使灵巧抓取任务的研究采取与平行抓取任务不同的方法。一些工作使用基于视觉输入的强化学习解决这个问题[2,3],但由于目前强化学习算法的局限性,通常这些方法很难学习不同物体不同姿态的通用抓取策略。

UniDexGrasp[4]使用物体课程学习(Object Curriculum Learning)以及知识蒸馏的方法学习了一个通用的视觉抓取策略。在 UniDexGrasp 中,一个局限性是基于状态(State-based)的教师策略只能达到79.4%的成功率,由此当使用知识蒸馏学习基于视觉(Vision-based)的学生策略时,学生策略的表现受到了很大的限制。另一方面,即使同一个物体,在不同位姿的下的几何信息也差异很大,而 UniDexGrasp 的物体课程学习只关注了物体类别却忽视了物体的位姿。我们提出了一种新的方法,UniDexGrasp++,关注不同物体不同位姿的几何差异,并利用通用策略-专家策略学习[5]方法,极大地提升了 UniDexGrasp 的泛化能力。

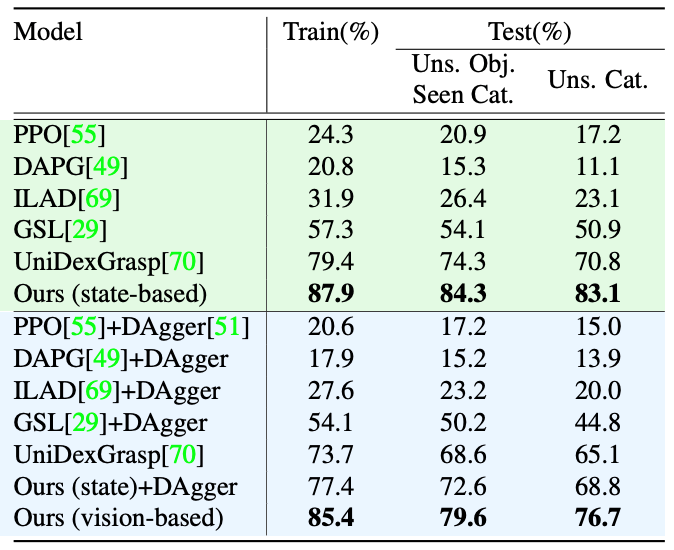

首先,为了提升基于状态的教师策略的表现,我们提出了使用场景点云的的几何特征来计算任务相似性的几何感知任务课程学习(GeoCurriculum)。为了进一步提高策略的泛化能力,我们采纳了通用策略-专家策略学习(Generalist-Specialist Learning, GSL)的理念,其中一组专家策略在任务空间的子集上训练,然后将其知识蒸馏给一个通用策略。我们进一步提出了几何感知的迭代通用策略-专家策略学习(Geometry-aware iterative Generalist-Specialist Learning, GiGSL),在这里我们使用几何特征来决定哪个专家处理哪个任务,并迭代地进行蒸馏和微调。我们的方法得到的基于状态的策略,在训练集和测试集上分别达到了87.9%和83.7%的成功率。

接下来,我们将表现最佳的专家策略蒸馏给一个基于视觉的通用策略,并在基于视觉的策略上再次进行 GiGSL,直至其性能饱和。通过我们完整的流程,我们最终的基于视觉的策略在3000+的物体实例上展现了普遍的灵巧抓取能力,其在训练集和测试集上的成功率分别为85.4%和78.2%,这显著地超越了最先进的基准。同时,完整的消融实验展现了我们提出的各个改进策略的优越性。

02 方法简介

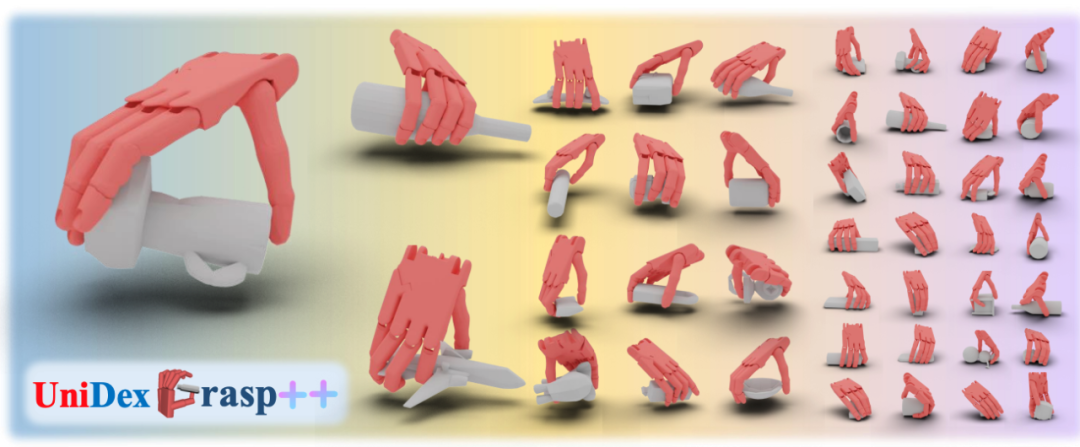

图2. 方法概览。左侧为基于状态的策略学习阶段,右侧为基于视觉的策略学习阶段。

方法概览

如图2所示,方法的流程分为左右两个阶段:第一阶段为基于状态的策略学习,第二阶段为基于视觉的策略学习。

在第一阶段中,我们的目标是得到一个基于状态的通用策略,该策略以机器人状态R_{t}、物体状态O_{t} 以及第一帧的场景点云P_{t=0}中获取输入。这里的物体点云是由多视角深度摄像机捕获的多个深度点云融合而成的。我们在输入中包括场景点云P_{t=0}以保留场景的几何信息,并使用预训练的点云自动编码器的编码器来提取其几何特征。这里使用的点云编码器是冻结的,以使其尽可能简单,因此它不会干扰策略学习。我们将P_{t}的视觉处理留给基于视觉的策略。尽管通过强化学习学习基于状态的策略比学习基于视觉的策略更容易,但在如此多样化的多任务设置下实现高成功率仍然非常具有挑战性。因此,我们提出了一个几何感知的课程学习(GeoCurriculum)来简化多任务 RL 并提高成功率。经过这个 GeoCurriculum,我们获得了第一个可以处理所有任务的基于状态的通用策略SG_{1}。然后,我们提出了一个几何感知的迭代通用策略-专家策略学习方法,称为 GiGSL,以进一步提高通用策略的性能。这个过程包括学习数个专门针对特定任务范围的基于状态的专家策略{SS_{i}}和将专家策略蒸馏为通用策略SG_{i+1}之间的迭代,其中i表示迭代索引。通过这种迭代学习,整体性能持续提高,直到饱和。

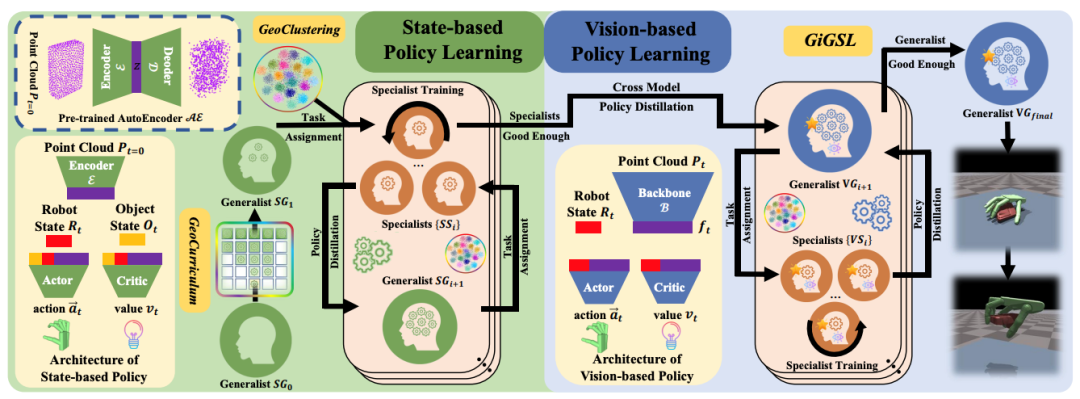

在第二阶段中,我们的目标是学习一个基于视觉的通用策略。对于基于视觉的策略,我们只允许它访问现实世界中可用的信息,包括机器人状态R_{t}和场景点云P_{t}。在这个阶段,我们需要联合学习一个从P_{t}中提取特征的视觉主干网络以及我们的策略(参见图2的蓝色部分)。在这里,我们采用 PointNet+Transformer[6]。我们随机初始化我们第一个视觉通用策略VG_{1}的网络权重。我们首先进行跨模态蒸馏,将最新的基于状态的专家{SS_{n}}蒸馏给VG_{1}。然后,我们开始对基于视觉的策略进行 GiGSL 迭代,这个过程在微调{VS_{i}}和蒸馏给VG_{i+1}之间迭代,直到基于视觉的通用策略的性能饱和。最终的基于视觉的通才VG_{final} 是我们学到的性能最高的通用抓取策略。整个流程的伪代码请参考图3。

图3. 算法伪代码

下面,我们分别详细介绍上述概览中提出的方法模块。

迭代通用策略-专家策略学习(iGSL)

我们在通用策略-专家策略学习[5]的基础上提出了迭代通用策略-专家策略学习。具体来说,我们将整个任务空间分割成多个子空间,并让一个专家策略负责一个子空间。由于每个子空间的任务变化较少,因此更容易学习,每个专家策略都可以受到良好的训练,并在其任务分布上表现出色。最后,我们使用 DAgger-based policy distillation 的方法将所有的专家策略蒸馏成一个通用的 A 策略,并重复迭代执行这个过程。

几何感知的迭代通用策略-专家策略学习(GiGSL)

对于 iGSL,一个重要难题是如何划分任务空间。之前的工作通常处理的是数量有限的任务,因此可以为每个任务指定一个专家,或者随机指定。然而,在我们的工作中,考虑到初始物体姿态可以连续变化,我们面临的是无数的任务。我们只能负担有限数量的专家策略,并需要找到一种方法将采样的任务分配给一个专家。我们认为,相似的任务需要被分配给同一个专家,因为只有当其任务变化很小时,一个专家策略通过强化学习才能有效地提高。为此,我们提出了基于几何的聚类策略(GeoClustering),这是一种在任务空间中进行几何感知聚类的策略。

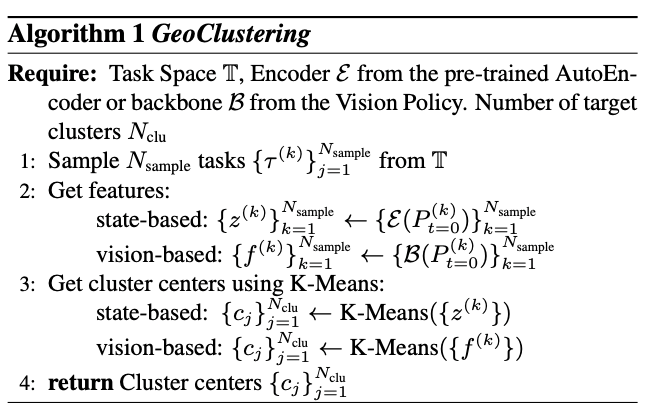

基于几何的聚类策略(GeoClustering)

我们将任务空间T=O*SO(3)分割成N_{clu}个簇,每个簇C_{j}中的任务在专家策略学习期间由指定的专家策略S_{j}处理。我们首先从任务空间T中采样大量的任务(在我们的实现中采样数≈270,000)并使用 K-Means 对其视觉特征进行聚类。大规模任务样本的聚类为整个连续任务空间的聚类提供了一个近似。我们还训练了一个 3D 点云的自编码器,以 Chamfer Distance 作为点云重建损失训练,以此得到点云的编码特征,更多细节请参见论文和补充材料。在为基于状态的专家进行聚类时,我们使用预训练的编码器 E 对每个任务的点云P(k)_{t=0}进行编码并获得特征z(k)。然后我们使用 K-Means 对这些采样任务的特征{z(k)}进行聚类,并生成N_{clu}个簇和相应的簇中心。对于基于视觉的专家,我们直接使用策略的视觉主干网络生成特征f(k)来替换基于状态设置中的相应编码特征z(k)。最后,专家策略的聚类可以表示为:在专家微调期间,我们在线为给定的任务\tau(k)分配一个专家策略来处理无限的任务空间。在微调期间,如果专家有最近的中心C_{j}到特征z_{k}或f_{k} ,我们将\tau(k)分配给SS_{j}或VS_{j}。然后,每个专家只需要在分配的任务集上进行训练,并将他们学到的特定知识蒸馏给通用策略,伪代码请参考图4。

图4. 基于几何的聚类(GeoCurriculum)伪代码

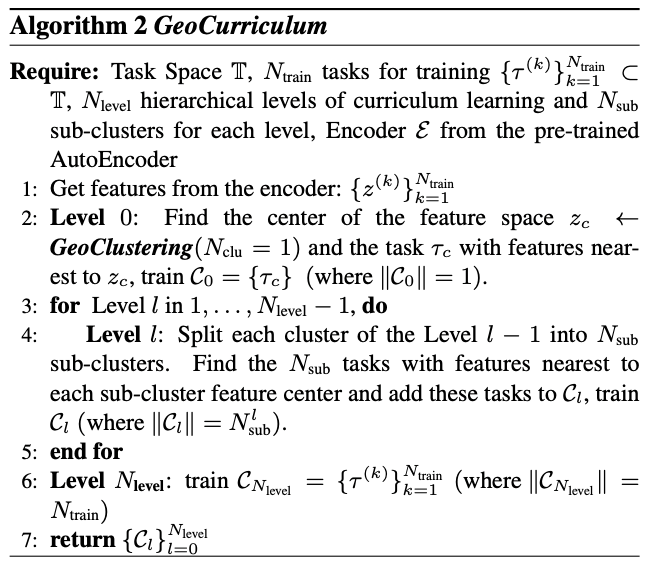

基于几何的课程学习(GeoCurriculum)

UniDexGrasp 中提出了物体课程学习。具体来说,物体课程学习首先使用 RL 训练一个策略来抓取一个对象实例(这个对象可能处于不同的初始姿态);一旦这个策略训练得很好,通过整合同一类别的几个相似对象来增加对象的数量,然后使用 RL 在新的对象集合上微调策略;接着,再次增加对象的数量,使用该类别的所有对象并微调策略;最后,将对象范围扩展到整个训练对象中的所有不同类别,并完成最终的微调。但是这种方法并没有考虑到物体的几何特征。利用几何特征来衡量任务之间的相似性,而不是对象身份和类别标签。因此,我们引入了 GeoCurriculum,一个利用层次任务空间划分的几何感知任务课程。具体来说,我们设计了一个多层次任务的课程,该课程将任务按照逐渐增加的变化级别分配给策略学习,并促进逐步学习。伪代码如图5所示。在训练过程中,我们迭代地在每个分配的任务集下训练策略。从在C_{0}中只处理一个任务到在C_{N_{level}} 中的所有训练任务,策略逐步成长,并且比直接在所有任务下训练它的性能更好。

图5. 基于几何的课程学习(GeoCurriculum)伪代码

03 实验结果

我们将我们的方法与其他基线方法的结果进行了比较。具体来说,我们使用了 UniDexGrasp 的 non-goal conditional setting,包含有来自133个物体类别的3165个物体,每个物体都在桌面上随机初始化位姿。详细成功率结果见图6。图6中列出了这些方法在训练集和测试集上的平均成功率。结果显示,UniDexGrasp++ 在训练集和测试集上分别达到85.4%和78.2%的平均成功率,显著优于其他方法。

图6. 抓取成功率结果比较

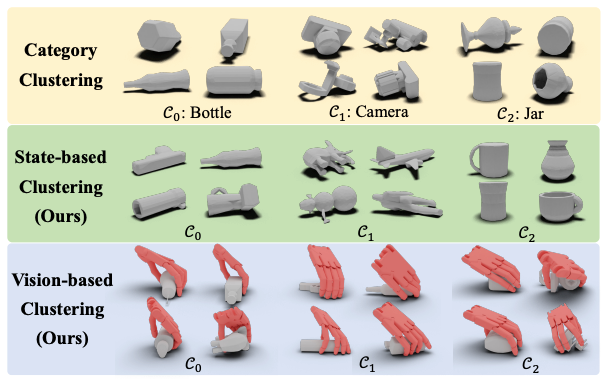

我们在图7中可视化了聚类策略的定性结果。第一行显示了一种简单的聚类方式,它基于对象类别,这种聚类方法没有对象几何信息,因此在抓取学习中帮助有限。第二行显示了我们基于状态的聚类策略,它基于点云编码器的特征,可以聚类具有相似形状的对象。在第三行,我们的使用的基于视觉的聚类策略利用了视觉骨干提取点云特征,它具有更多的任务相关信息,因此聚类的对象不仅形状相似,而且抓取姿势也相似, 更有利于每个专家策略的学习。

图7. 不同聚类策略的定性可视化结果

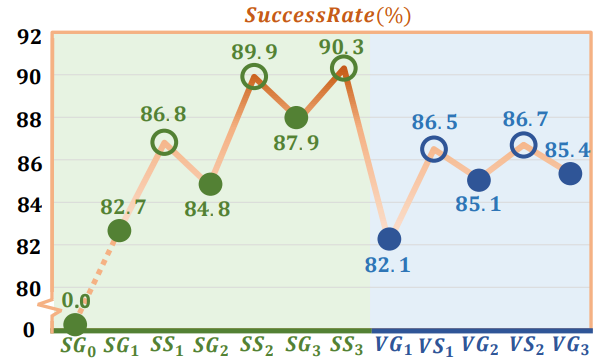

同时,我们在图8中可视化了每个学习或微调步骤的成功率。无论是对于基于状态的策略还是基于视觉的策略,通用策略-专家策略微调和蒸馏的改进都显示了几何感知迭代通用-专家学习 GiGSL 策略设计的有效性,并提高了通用灵巧抓取的最终性能。

图8. GiGSL 算法过程中的成功率变化

参考文献

[1] ShadowRobot. https://www.shadowrobot.com/dexterous-hand-series/, 2005.

[2] Priyanka Mandikal and Kristen Grauman. Dexvip: Learning dexterous grasping with human hand pose priors from video. In CoRL 2021.

[3] Yuzhe Qin, Binghao Huang, Zhao-Heng Yin, Hao Su, and Xiaolong Wang. Dexpoint: Generalizable point cloud reinforcement learning for sim-to-real dexterous manipulation. In CoRL 2022.

[4] Yinzhen Xu, Weikang Wan, Jialiang Zhang, Haoran Liu, Zikang Shan, Hao Shen, Ruicheng Wang, Haoran Geng, Yijia Weng, Jiayi Chen, Tengyu Liu, Li Yi, and He Wang. UniDexGrasp: Universal robotic dexterous grasping via learning diverse proposal generation and goal-conditioned policy, In CVPR 2023.

[5] Zhiwei Jia, Xuanlin Li, Zhan Ling, Shuang Liu, Yiran Wu, and Hao Su. Improving policy optimization with generalistspecialist learning. In ICML 2022.

[6] Tongzhou Mu, Zhan Ling, Fanbo Xiang, Derek Yang, Xuanlin Li, Stone Tao, Zhiao Huang, Zhiwei Jia, and Hao Su. Maniskill: Generalizable manipulation skill benchmark with large-scale demonstrations. arXiv preprint arXiv:2107.14483, 2021.