课题组报告:UCLA陈翔博士谈开拓人与AI之间的交互带宽

2019年12月24日,UCLA助理教授陈翔博士受邀访问北京大学前沿计算研究中心,并在静园五院做了题为“Expanding the Interaction Bandwidth between Human and AI(开拓人与AI之间的交互带宽)”的主题报告。报告由中心助理教授孔雨晴博士主持,听众主要是来自信息科学技术学院的师生。

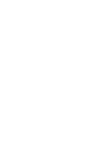

陈博士先阐述了当前 AI 的“黑箱问题”,即尽管以 AI 为基础的智能系统越来越普遍,但是由于 AI 数据驱动的本质,它往往被作为一个“黑箱”来用。尽管使用AI的障碍很小,我们只需要把有相关性的输入输出数据放入模型进行训练即可,但是 AI 的使用者并不知道这个黑箱是怎么工作、为什么工作、为什么有时候不工作的。人脸识别的软件把黑人识别成了猩猩、车辆的自动驾驶系统未能阻止撞死行人、智慧医疗系统将病人的护理时间缩减却无法给出原因……这一系列问题的出现,都意味着人类和 AI 之间的交互带宽是亟待扩展的。

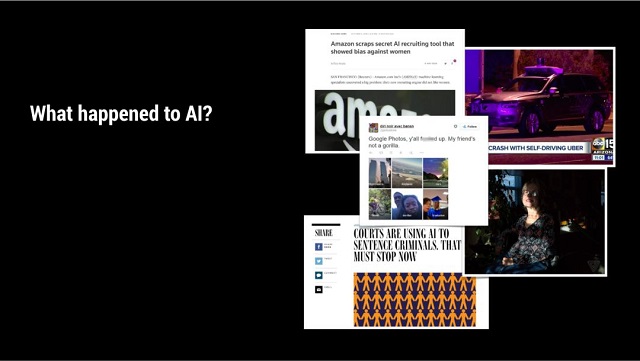

接下来,陈博士从拓宽 AI 到人类的带宽、人类到 AI 的带宽和人类与 AI 之间的带宽三个方面,即 How to design AI to be comprehensible, How to enable users to customize AI, How to support human-AI collaboration 三个问题,介绍了他最近的研究。

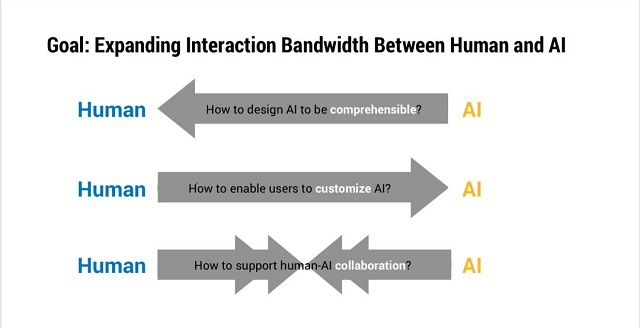

可解释性 AI(XAI)是一个较为热门的话题,但是当前的研究往往都聚焦于模型本身的可解释性,而对于真实世界中不同领域的用户对模型的可解释性的需求则研究甚少。陈博士介绍了近期一个从 HCI 的角度出发的对于分析胸部X光图片的AI的可解释性的工作,这个工作通过迭代的方式,先调查这个 AI 的用户,即医生,对可解释性的需求是什么,设计出一个粗略的系统,再由用户来改善,最终设计出一个为用户提供模型的可解释性的系统的雏形。比如,这个系统在给出病人的可能患病结果后,可以提供相关病变的照片和病人过去的照片。这就相当于在人类和AI之间增加一个用来解释的层。

而如何让用户去定制 AI,有两大挑战:其一,用户如何向 AI 表达它们的意图,其二,用户如何把它们的知识教给 AI。对于第一个挑战,陈博士介绍了最近的一个在工业设计领域的工作,该工作完成的系统让用户画一个想要设计的物体的草图,由 AI 来通过符合工程学的目标函数来优化它的精确设计,用户也可以通过增加或删除线条来改善设计。而对于第二个挑战,由于人类与 AI 很难进行直接交流,现在大家往往用演示或者示例的方式来训练模型,还存在着很大的研究空间。

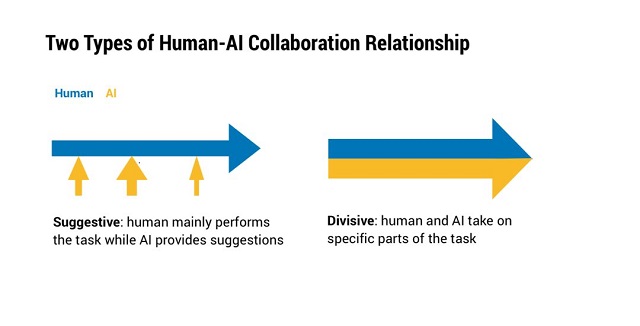

人类和 AI 的合作主要有两种方式,第一种是 suggestive 的,即人类进行工作的过程中 AI 提供建议,比如在医生用医疗图像来诊断病人的时候,阅读正常图像是很费时费力的,而 AI 则可以通过框图的方式来给医生提出建议,从而来减少医生的负担;第二种是 divisive 的,则人类和 AI 同时各完成任务的一部分,比如那款工业设计的系统,人类来进行 high-level 的草图,AI 则负责 low-level 的加工,二者相互合作,共同完成设计。然而,这种模式下的一个挑战是如何自动给人类和 AI 分配任务,因此 manage AI,即用来给人类和AI分配任务的 AI,也是下一代 AI 需要考虑的。

报告结束后,陈博士和中心的师生进行了深入交流,讨论各种科研思路的可能性。